Comment Les Plateformes Optimisent Leurs Outils De Prévention

Introduction Aux Outils De Prévention Sur Les Plateformes Numériques

Dans l’univers dématérialisé des plateformes en ligne, la prévention des contenus abusifs et malveillants représente un enjeu majeur. Garantir la confiance des utilisateurs suppose le recours à des outils de modération performants et adaptés aux exigences réglementaires.

Les règles encadrant ces pratiques s’inscrivent notamment dans les obligations de la CNIL, la stricte application du RGPD et le cadre du Digital Services Act (DSA). Ces textes imposent aux acteurs numériques de protéger les données personnelles tout en assurant la lutte contre les abus.

Définitions Clés

Parmi les concepts fondamentaux, la modération automatique désigne l’usage de systèmes informatiques pour filtrer en temps réel les contenus inappropriés, sans intervention humaine systématique. Cette approche se combine souvent à une modération humaine pour trancher les cas sensibles.

La sécurité numérique englobe l’ensemble des dispositifs techniques et organisationnels visant à protéger les plateformes et leurs utilisateurs contre divers risques, tels que le spam, le harcèlement ou la diffusion de contenus illégaux.

L’Importance Des Outils De Prévention En France

Dans le contexte français, l’écosystème numérique s’appuie sur des outils de prévention afin d’assurer une expérience utilisateur respectueuse et conforme aux valeurs traditionnelles du jeu et de l’échange public. Leur efficacité conditionne la pérennité des plateformes et leur crédibilité.

Sans une prévention adaptée, les espaces numériques risquent de devenir des environnements toxiques, où le plaisir du jeu et de la discussion serait altéré. À cet égard, chaque opération doit s’apparenter à l’ajustement minutieux d’une recette gastronomique : trouver l’équilibre entre rigueur et souplesse pour obtenir un résultat optimal.

Pour mieux comprendre ces principes fondamentaux, il convient d’explorer maintenant les typologies d’outils utilisés sur ces plateformes majeures.

Métriques clés pour mesurer l’efficacité des outils de prévention

Taux de détection : la première ligne de défense

Le taux de détection, ou TPR (True Positive Rate), représente la capacité d’un système aquawin casino à identifier correctement les contenus abusifs. C’est l’indicateur fondamental car il détermine la réactivité d’un outil à bloquer les comportements préjudiciables avant qu’ils ne portent tort à la communauté.

Sur les grandes plateformes, ce taux dépasse souvent 50 %, ce qui signifie qu’une grande partie des abus est interceptée avant même d’être visible. Une performance qui demande un affinement constant pour ne pas négliger les subtilités du contenu, notamment dans des contextes à la frontière de la tolérance.

Taux de faux positifs : l’équilibre délicat

Le taux de faux positifs (FPR) désigne la proportion d’erreurs où un contenu sain est injustement supprimé ou masqué. Trop élevé, il entraîne frustration des utilisateurs et remise en cause de la modération, notamment auprès des créateurs de contenu.

Les plateformes privilégient donc un équilibre rigoureux, mêlant automatisme et intervention humaine pour réduire ces erreurs. C’est un combat permanent pour éviter que la vigilance ne devienne étouffante.

Latence et délai de traitement : une question de fluidité

La rapidité avec laquelle un abus est détecté et traité influence fortement l’expérience utilisateur. Une modération trop lente laisse le temps au dommage de s’étendre, alors qu’une intervention trop rapide sans discernement peut priver d’expression certains commentaires légitimes.

Les outils performants visent à réduire cette latence sans pour autant sacrifier la pertinence des décisions. En combinant l’instantanéité des algorithmes et la finesse des modérateurs, la fluidité de l’interaction reste un objectif majeur.

Couverture des cas d’usage : ne rien laisser passer

Un outil efficace doit couvrir un large spectre d’abus, du simple spam au discours haineux en passant par la désinformation et le harcèlement. Cette couverture garantit que les plateformes conservent un environnement sain pour l’ensemble des participants, fidèle aux valeurs du jeu et de la convivialité.

Chaque nouvelle forme de nuisance repérée adapte le filtre pour la prise en compte, comme un sommelier qui ajuste la sélection en fonction des millésimes et des nuances de terroir.

Indicateurs d’expérience utilisateur : le ressenti au cœur du dispositif

Au-delà des métriques techniques, l’évaluation du ressenti utilisateur, par exemple via le score NPS (Net Promoter Score), oriente les ajustements des outils. Ce retour direct reflète la qualité perçue de la modération et la confiance dans la plateforme.

Un mauvais score peut signaler un déséquilibre entre sécurité et liberté d’expression, nécessitant un affinage des seuils et des processus. Une expérience aussi soignée qu’un plat équilibré, où chaque saveur trouve sa place.

Tableau récapitulatif des métriques et impacts

| Métrique | Définition | Impact principal |

|---|---|---|

| Taux de détection (TPR) | Pourcentage d’abus correctement identifiés | Réduction des comportements nuisibles |

| Taux de faux positifs (FPR) | Pourcentage de contenu sain erronément bloqué | Qualité de l’expérience utilisateur |

| Latence | Délai entre détection et action | Fluidité d’interaction, réponse rapide |

| Couverture des cas | Variété des abus détectés | Protection complète des utilisateurs |

| Score NPS | Mesure de satisfaction et recommandation | Perception de la modération, fidélité |

L’importance d’un suivi constant et ajusté

Ces indicateurs ne prennent sens que dans une dynamique d’amélioration continue. Comme un grand chef ajuste ses recettes au retour des convives, les plateformes doivent sans cesse revisiter leurs outils en fonction des données recueillies.

Le dialogue entre technologie et humain, allié à ces mesures, offre la garantie d’un ordre bien tenu sans brider la richesse des échanges.

Comparaison des performances inter-plateformes et bonnes pratiques

Les grandes plateformes sociales déploient toutes des mécanismes de prévention et modération automatisée qui diffèrent tant dans leurs performances que dans leur approche. Les priorités varient souvent entre latence, couverture des contenus, coût opérationnel et qualité de l’expérience utilisateur.

Commençons par un tableau simplifié qui présente une vue synthétique des scores estimés pour TikTok, Facebook, Snapchat, Discord et LinkedIn selon ces critères.

| Plateforme | Latence API | Couverture des cas critiques | Coût outils prévention | Réception utilisateur | Type de modération |

|---|---|---|---|---|---|

| TikTok | Très faible (rapide) | Large, surtout contenu vidéo | Relativement élevé | Critiques sur faux positifs | Hybride (ML + humain) |

| Faible | Très large (texte, image, vidéo) | Élevé | Acceptation mitigée | Hybride, forte part humaine | |

| Snapchat | Moyenne | Spécifique contenus éphémères | Moyen | Assez bien reçu | Automatisée avec surveillance |

| Discord | Variable selon serveur | Ciblée, modération communautaire | Relativement faible | Plutôt positive | Modération humaine + bots |

| Faible | Professionnel et spam | Modéré | Élevée sur les contenus pros | ML avec modérateurs experts |

En analysant cette matrice, il apparaît que TikTok et Facebook dominent par la couverture et la latence rapide, indispensables à leurs formats riches. Toutefois, cela engendre un coût très élevé et un taux notable de faux positifs, créant ainsi une tension dans l’équilibre entre automatisation et contrôle humain.

À l’inverse, Discord illustre une stratégie plus communautaire où les responsables locaux complètent la détection algorithmique. Ceci réduit fortement le coût mais limite la couverture et standardise moins les règles, reflétant l’esprit vivant d’une table de jeu traditionnelle où le croupier humain règle la partie.

Au cœur de la modération efficace, le « mixte » reste la recette française du succès adapté aux contraintes modernes. En effet, si l’automatisme assure la rapidité pour couper court aux abus, la surveillance humaine, telle une main experte au blackjack, ajuste la sanction en fonction du contexte.

Les meilleures pratiques consistent souvent à ajuster finement les seuils d’alerte automatisés, et renforcer la formation des modérateurs pour déceler les nuances, comme un sommelier reconnaît un cépage subtil dans un grand cru.

Impact de l’expérience utilisateur sur l’optimisation des outils

L’expérience utilisateur est le fil conducteur qui guide l’affinage des mécanismes de prévention. Il ne sert à rien d’avoir un système ultra-performant s’il dégrade la confiance ou crée un sentiment d’injustice chez l’utilisateur.

Trois retours majeurs ressortent des plateformes :

- Frustration liée aux faux positifs : Des contenus légitimes parfois supprimés affectent la satisfaction et la fidélisation.

- Clarté des notifications : Les utilisateurs réclament des explications précises et des recours accessibles pour comprendre et contester les décisions.

- Perception d’équité : La modération doit paraître juste et non arbitraire, sous peine de distiller un climat de défiance.

En réponse, plusieurs plateformes ont pris soin d’implémenter des ajustements comportementaux notables. Par exemple, YouTube a recentré ses notifications sur des messages pédagogiques plutôt que punitifs, afin d’apaiser et informer. TikTok a révisé ses algorithmes pour réduire les coupures automatiques sur certains contenus sensibles tout en intensifiant la surveillance humaine.

Ces modifications témoignent de la nécessité d’une écoute active des utilisateurs pour nourrir le réglage intelligent des outils. La roulette et le blackjack n’ont jamais reposé que sur la maîtrise technique alliée à la compréhension fine de l’adversaire, ici incarné par l’usager.

Organisation et gestion des données pour optimiser la prévention

La prévention repose sur une gestion méthodique et rigoureuse des flux de données captées en continu. Leur collecte, traitement et analyse sont essentiels pour ajuster les seuils de détection et anticiper de nouveaux types d’abus.

Le processus s’articule ainsi :

- Identification des données clés : commentaires, signalements, métadonnées temporelles, historiques utilisateurs.

- Stockage sécurisé : bases de données protégées respectant les règles de conformité, notamment RGPD.

- Analyse dynamique : exploitation par des tableaux de bord BI intégrés facilitant les indicateurs en temps réel.

- Feedback continu : remontée des cas humains corrigés pour ajuster les modèles ML.

- Rapports automatisés : synthèses régulières pour guider la stratégie d’évolution des outils.

Une telle organisation évoque le ballet délicat entre les cuisiniers et le maître d’hôtel : chaque donnée est un ingrédient à disposition pour créer, ou rectifier, une recette prenant en compte attentes, contraintes et saveurs du moment.

Défis et limites actuels des outils et perspectives d’amélioration

Si les avancées technologiques ont indéniablement amélioré la prévention des abus, les plateformes doivent faire face à plusieurs défis persistants. Les biais algorithmiques, comme une mauvaise appréciation culturelle ou contextuelle, peuvent nuire à la pertinence des décisions.

L’évolution rapide des méthodes d’abus complique aussi la scalabilité des outils, qui doivent s’adapter en temps réel sans saturer les équipes humaines.

Côté perspectives, les voies d’amélioration portent avant tout sur :

Une personnalisation accrue des systèmes permettant d’ajuster les interventions selon le profil utilisateur, semblable à un maître fromager qui adapte son affinage au terroir.

L’adoption d’IA multi-modales, mêlant texte, image et son, pour détecter des schémas d’abus plus subtils.

Enfin, plus de transparence dans les processus de modération engagera davantage la confiance des utilisateurs. Offrir des clés de compréhension, c’est comme ouvrir un volet sur les coulisses d’un spectacle, assurant que le public partage les règles du jeu.

Synthèse des facteurs-clés pour une optimisation réussie

Réussir à optimiser la prévention des abus tout en préservant une expérience sociale positive sur les plateformes requiert un équilibre subtil. Il faut à la fois une technologie solide, un respect strict de la réglementation et un dialogue constant avec les usagers.

Trois ingrédients majeurs émergent :

- Équilibre entre automatisation et modération humaine : la technologie doit assister mais ne pas remplacer le jugement expert.

- Prise en compte du retour utilisateur : les ajustements doivent refléter une écoute attentive aux besoins et ressentis réels.

- Maîtrise des coûts et conformité : une solution efficace doit être économiquement viable tout en respectant les cadres légaux rigoureux.

Ce trio faisons penser à la trilogie classique de la gastronomie française : produits de qualité, savoir-faire et respect des traditions. En modération, ces principes constituent le socle pour garantir un jeu loyal et agréable, un art de vivre digital pour tous.

AGENDA

Soirée papote la pelote

Brico-histoire

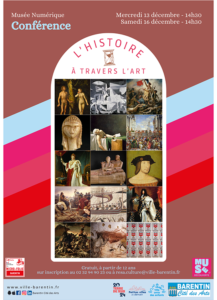

L’histoire à travers l’art

Atelier ranger son ordinateur

Tap Factory

Lire delivre

- Comment La Gamification Influence Les Comportements Utilisateurs

- Pourquoi Linnovation Graphique Séduit Le Public Jeune

- Connexion Betwinner : Accédez Facilement à l’Univers des Paris en Ligne

- SafeCasino 2025 : Plateforme de Jeu aux Standards Européens

- Pourquoi les moments de crash d’Avia Masters sont souvent psychologiques